软件说明

彼岸壁纸网的壁纸特别好看,而且很多二次元的,分类齐全,但是网站每天只能下载一张,但是有了这个软件我们就可以把它的壁纸全部扒下来,自己随便怎么使用,本软件是一款使用易语言编译的下载软件,知道易语言的都应该了解,易语言在很多安全软件下都会报毒,这里说明本软件绝对安全!

声明:彼岸的壁纸,个人觉得是真的好看,算是做得最好的一家了,虽然是免费限时限量下载,但是对于有条件的小伙伴,还是可以付费支持一下的,毕竟不贵,只需要30元就可以全站无限制下载了。

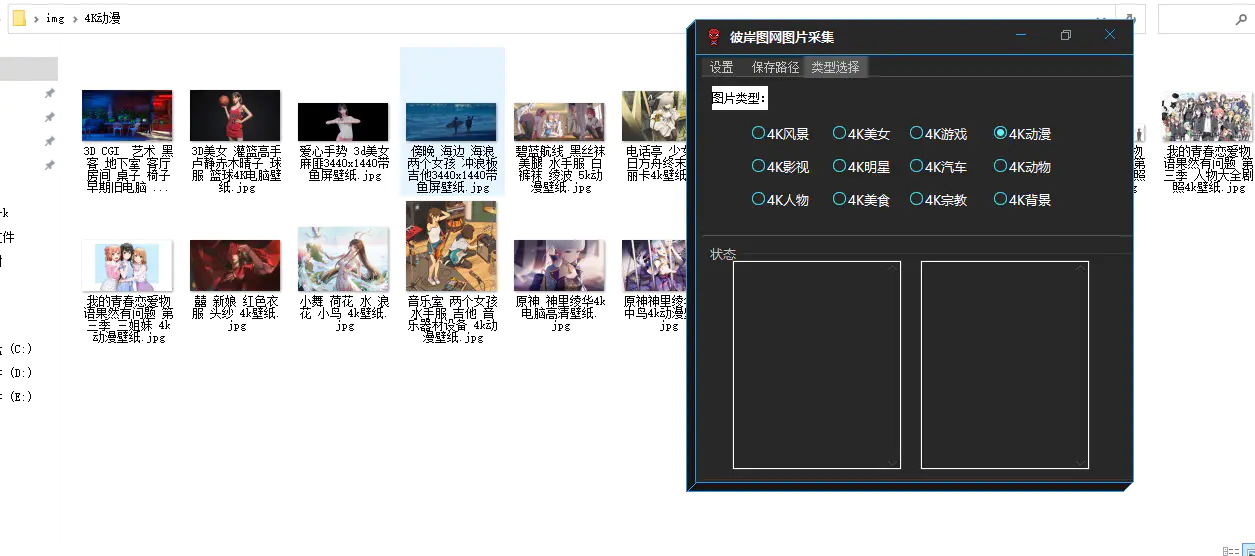

使用说明

- 下载后设置保存路径

- 选择需要采集壁纸的分类

- 设置从几页到几页开始采集即可

其他说明

另外我们还可以使用python实现自动采集,废话不多说,直接上代码

#-*- coding = utf-8 -*-

#@Time : 2022/07/27 20:30

#@Author : 360模板吧

#@File : 03.py

#@Software : PyCharm

import requests #引入第三方数据请求模块

import parsel #引入解析数据模块:Parsel是一个使用XPath和CSS选择器从HTML和XML提取数据的库。

import os #引入OS模块

import time #引入time模块

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/70.0.3538.25 Safari/537.36 Core/1.70.3877.400 QQBrowser/10.8.4506.400'

} #设置请求的UA,代表浏览器的身份标识

filename = 'img1\\' #定义img1文件夹

if not os.path.exists(filename): #使用os.path.exists判断存不存在img1文件夹

os.mkdir(filename) #不存在使用mkdir创建img1文件夹

for a in range(62,126): #使用for循环遍历每一页,用range传入每一页

print(f'-----------------正在爬取第{a}页的壁纸-----------------------') #打印翻页数

#使用requests模块的get请求网页

url = f'https://pic.netbian.com/4kmeinv/index_{a}.html' #URL的翻页设置

res = requests.get(url,headers=headers) #用get请求网页,并设置请求UA,赋值给res参数

res.encoding = res.apparent_encoding #识别编码并自动转码

time.sleep(30) #延时10秒发送请求,避免反爬被办IP

html_str = res.text #text 获取对象里面的文本数据 字符串类型 --> 正则表达式

#print(html_str)

#解析网页

selector = parsel.Selector(html_str) #转换数据类型,转换成selector对象,使用CSS选择器提取

a_url = selector.css('.slist ul li a img::attr(src)').getall() #使用css选择器来定位获取所有img标签的src属性

lis = selector.css('.slist li') #使用CSS标签选择slist属性的li标签

for li in lis: #使用for循环来遍历title名字和图片url地址

title = li.css('b::text').get() #使用CSS选择器获取b标签的text文本内容

if title: #图片title内容

img_url = "https://pic.netbian.com" + li.css('img::attr(src)').get() #给图片地址添加网站合成完整图片链接

img_content = requests.get(url=img_url).content #发送图片链接请求,获取图片数据。图片是二进制数据,content 提取二进制数据

with open(filename + title + '.jpg',mode='wb') as f: #给图片重命名

f.write(img_content) #保存图片

print(title,img_url) #打印完整图片链接列表和图片名称

1.使用本站下载的源码仅限于个人学习和非商业用途。

2.禁止将本站下载的源码用于搭建或支持任何违法、淫秽、暴力或侵犯他人合法权益的网站或应用。

3.使用本站下载的源码需遵守国家法律法规及相关规定,不得从事任何违法活动。

4.如若本站内容侵犯了原著者的合法权益,请联系我们进行处理。

评论(0)